20 év AWS: felnőtt, mint egy gyerek – és mi vele változtunk

Amikor elkezdtem az informatikával foglalkozni, teljesen természetes volt, hogy ha egy cégnek új alkalmazás kellett, akkor először szervereket kellett rendelni. Fizikai vas, rack szekrény, kábelek, és rengeteg várakozás…Hetek, néha hónapok.

És ha valamit rosszul méreteztünk? Akkor annak komoly következménye volt. Vagy alacsony volt a kapacitás, vagy túl sok volt. a felesleges erőforrás. Nehéz volt pontosan megbecsülni, hogy mennyi az optimális.

Majd 2006 környékén megjelent valami, ami akkor még sokaknak csak egy furcsa kísérletnek tűnt: az Amazon Web Services.

Ma, 20 évvel később, visszanézve egészen elképesztő, hogy mennyire természetessé vált az, ami akkor hihetetlenül új volt.

Az első lépések: S3 és EC2

Az AWS indulásakor két szolgáltatás volt igazán meghatározó:

Az S3 egy végtelennek tűnő tárhelyet adott, ahol nem kellett többé diszkeket kezelni. Az EC2 pedig azt mondta: nem kell szervert venned, csak kérj egyet.

Ez ma már természetesnek hat, akkor viszont paradigmaváltás volt.

Persze eleinte mindenki ugyanúgy használta a cloud-ot, mint a saját adatközpontját. Lift-and-shift, csak máshol futott a VM.

Ez azonban nem a felhő valódi ereje.

A cloud nem infrastruktúra, hanem szemlélet

Az elmúlt években igyekszem minden tanítványomnak és mentoráltamnak elmondani, hogy a cloud nem csupán technológia. Ez egy másik gondolkodásmód.

Például:

- Nem előre vásárolsz kapacitást, hanem használat alapján fizetsz. (Pay-As-You-Go)

- Nem szerverekben gondolkodsz, hanem szolgáltatásokban.

- Nem “mi van ha kelleni fog”, hanem “ma mire van szükségem”

- Ha nem használod, kapcsold le!

Ez elsőre egyszerűnek hangzik, de amikor sokan átköltöznek a cloud-ba, a gondolkodásuk marad on-premise. Emiatt sokkal drágábban és kevésbé hatékonyan tudják kihasználni a felhőszolgáltatók által kínált megoldásokat és lehetőségeket.

Ebből jönnek a klasszikus problémák:

- túlméretezett VM-ek: elszállnak a költségek

- le nem állított fejlesztői környezetek: felesleges kiadások

- manuális folyamatok: nincs valódi skálázódás, nincs valódi felügyelet

Webalkalmazás régen és ma

Régen egy egyszerű webalkalmazás így nézett ki:

- 2 fizikai szerver (web + adatbázis)

- terheléselosztó külön hardveren

- backup külön megoldással

- manuális skálázás

- napokig vagy hetekig tartó telepítés

Ma ugyanez AWS-ben:

- Elastic Load Balancing

- auto scaling EC2 instance-ok

- Amazon RDS

- Amazon S3 backup-hoz

- Automatizált alkalmazás telepítés percek alatt

És ami fontos: Nem kell mindent egyszerre megcsinálni.

Sokan ott rontják el, hogy nem fokozstosan alakítják ki a környezetet, hanem mindent egyszerre akarnak. Ez sokször akkora falat, hogy elbukik a teljes megvalósítás.

Én azt javasolom, hogy lépésenként haladjon mindenki: Először tervezzük meg a minimálisan elegendő, de biztonságos architektúrát. Utána érjük el, hogy működjön. Aztán legyen szép. Végül legyen skálázható.

Azure és GCP – ugyanaz a történet más szemszögből

Az AWS elindította ezt a hullámot, de ma már nem egyedül van.

Mindkettő ugyanazt a problémát oldja meg: Hogyan tudunk gyorsan, rugalmasan és biztonságosan rendszereket építeni?

Azure-nál például egy Azure VM vagy Azure SQL Database ugyanazt a gondolatot viszi tovább, mint EC2 és RDS. GCP-nél pedig a felügyelt szolgáltatások még erősebben jelen vannak. A különbség inkább filozófia és integráció. Az alap minden esetben ugyanaz.

Amit 20 év alatt megtanultunk

Ha visszanézek erre a 20 évre, van néhány dolog, ami nagyon tisztán látszik:

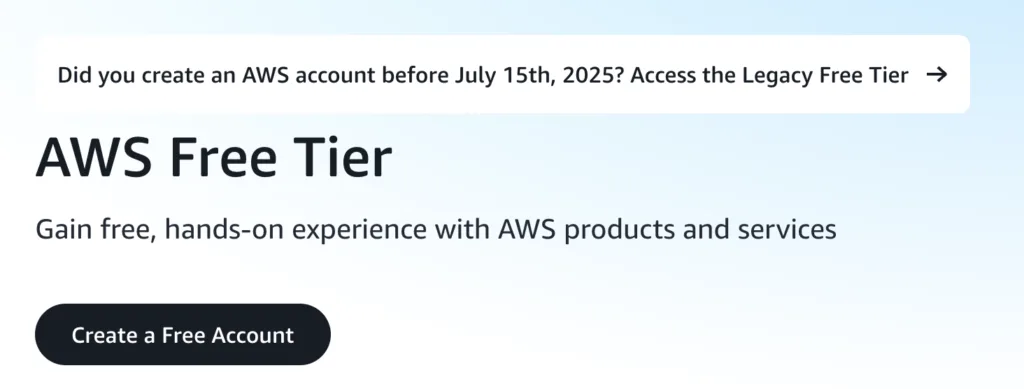

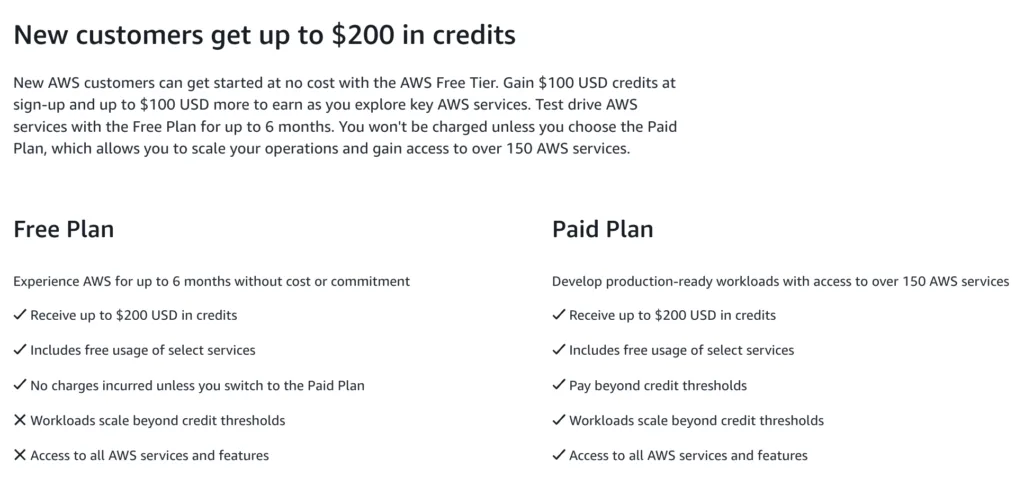

1. A komplexitás nőtt – de a belépési küszöb csökkent

Ma bárki elindíthat egy alkalmazást percek alatt. Látványosan és stabilan. Azonban egy jól működő, biztonságos rendszer már komoly tervezést igényel.

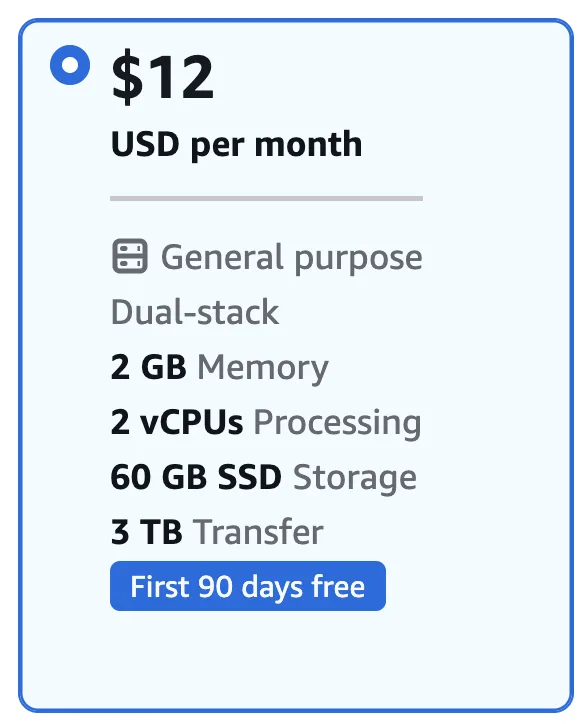

2. A költség optimalizálás nem opcionális

A cloud egyik legnagyobb előnye a rugalmasság. És egyben a legnagyobb csapda is. Hiszen:

A felhő is csak akkor gazdaságos, ha okosan használjuk

3. A DevOps már nem lehetőség csupán

CI/CD, IaC, automatizálás – ezek nélkül ma már nem lehet hatékonyan működni.

4. A biztonság az alapoktól kezdődik

IAM, hálózat, access control – ha ezek nincsenek rendben, minden más kockázatos.

És az AI

Az elmúlt 2-3 évben egyértelműen egy új irány alakult ki: AI.

Az AWS-nél például a Amazon Bedrock, Azure-nál az Azure OpenAI, GCP-nél a Vertex AI.

A legfontosabb: Ez nem egy külön világ.

Ez a cloud következő rétege. Ezzel kapcsolatban olvasd el a AI + Cloud 2026: amikor a platform életre kel és gondolkodik című cikkemet.

A felhő továbbra is ugyanarra az alapra épül, amit az elmúlt 20 évben, de komolyabb, komplexebb és meghatározó lett.

Egy személyes gondolat a végére

Ha valaki ma kezd bele a cloud-ba, lehet, hogy azt látja: rengeteg szolgáltatás, rengeteg opció, rengeteg zaj. És ez igaz is.

Ha azonban kicsit mélyebbre nézünk, akkor ugyanaz a történet, mint 20 éve:

- hogyan tárolunk adatot

- miként futtatunk alkalmazásokat

- mit tesszük azért, hogy ez biztonságosan és költséghatékonyan működjön

Csak most már sokkal több eszközünk van rá. És talán ez a legérdekesebb az egészben: Nem az változott meg, amit csinálunk, hanem az, ahogyan csináljuk.

Merre tovább?

Ha most ismerkedsz a clouddal, ne akarj mindent egyszerre megérteni.

Kezdd egyszerűen:

- néhány VM

- egy storage

- majd az alap hálózat

- végül az adatbázis

És értsd meg, mi történik a háttérben. Ha pedig már benne vagy: érdemes néha megállni, és visszanézni.

Mert könnyű elveszni a napi taskokban, és nem észrevenni, hogy közben egy teljes iparág alakult át körülöttünk.