GitHub Copilot új árazás: fizetsz, amennyit használsz

Aki az elmúlt évek fejlesztői eszközeinek átalakulása során figyelemmel kísérte, hogyan változott a GitHub Copilot, az tudja, hogy ez az eszköz ma már egészen más valami, mint amivel 2022-ben találkoztunk.

Akkor még egy okos kódkiegészítő volt. Ma már autonóm módon képes végigmenni egy teljes repository módosításain, több lépéses feladatokat old meg önállóan, és elég jó nagy nyelvi modelleket használ közben. Ez a fejlődés szép, de számolni kell azzal, hogy komoly infrastrukturális igénnyel jár a hátterben.

Nem véletlen tehát, hogy a GitHub nemrég bejelentette: 2026. június 1-jétől az összes Copilot csomag áttér a felhasználás alapú számlázásra, angolul usage-based billing modellre. Ez az egyik legjelentősebb árképzési változás, ami az eszköz életében eddig történt. Érdemes pontosan megérteni, mit jelent ez a gyakorlatban.

Mi volt eddig, és mi változik

Az eddigi rendszer úgynevezett premium request unit-okra (PRU) épített. Minden Copilot csomag tartalmazott egy havi kvótát ezekből az egységekből, és ha valaki elfogyasztotta a keretét, egy olcsóbb modellre esett vissza, de tovább tudott dolgozni.

Június 1-jétől ezt a rendszert felváltják a GitHub AI Credits. A lényeg: a kreditfogyasztás token-alapon számolódik, beleértve a bemeneti, kimeneti és gyorsítótárazott tokeneket is, a GitHub által nyilvánosan közzétett API árak szerint. Fontos kiemelni, hogy az alap kódkiegészítés és a Next Edit Suggestions funkció nem fogyaszt kreditet – ezek minden csomagban megmaradnak korlátozás nélkül.

A visszaeső modellre való automatikus átkapcsolás viszont megszűnik. Ha valaki elfogy a kreditjeiből, a rendszergazda által beállított keret vagy a kreditvásárlás az egyetlen megoldás. Ez egy komoly szemléletváltás: az eddig „láthatatlan” korlát mostantól pénzben is megjelenik.

Mennyit kap mindenki a csomagjával

Az alaptervek ára nem változik, ez fontos. Amit kap az ember, az most már kredit formájában van meghatározva:

| Csomag | Havi ár | Kapott havi AI Credit |

|---|---|---|

| Copilot Pro | 10 USD | 1 000 kredit |

| Copilot Pro+ | 39 USD | 3 900 kredit |

| Copilot Business | 19 USD/fő | 1 900 kredit/fő |

| Copilot Enterprise | 39 USD/fő | 3 900 kredit/fő |

Az átváltás egyértelmű: 1 AI Credit = 0,01 USD, tehát a Pro csomag 1 000 kreditje 10 USD értékű fogyasztást fed le. A különbség ott jelenik meg, ha valaki többet használ, mint amennyit a csomag tartalmaz: ekkor a GitHub nyilvánosan közzétett API árain lehet további kreditet vásárolni.

A Business és Enterprise ügyfelek egy átmeneti kedvezményes időszakot is kapnak. Június 1-jétől szeptember 1-jéig emelt kreditkeretet biztosít a GitHub: Business ügyfeleknek 3 000 kreditet, Enterprise ügyfeleknek 7 000 kreditet fejenként és havonta.

A kreditek ráadásul nem egyénileg vannak elszámolva, hanem szervezeti szinten összeadódnak – ha egy Business csomagos cégnél 100 felhasználó van, az egy 190 000 kredites közös készletet jelent a normál időszakban, nem 100 különálló keretet.

Mit jelent ez vállalati szempontból

Aki enterprise környezetben dolgozik, annak ez az egyik legfontosabb változás. A GitHub most bevezeti az úgynevezett pooled usage modellt, ami azt jelenti, hogy a szervezeten belüli fel nem használt kreditek nem egyénileg „égnek el”, hanem egy közös készletbe kerülnek, amit más kollégák is felhasználhatnak. Ez egy nagyon is megfontolandó lépés: az eddigi rendszerben rengeteg vállalat fizetett license-eket, amelyek felét talán ki sem használták.

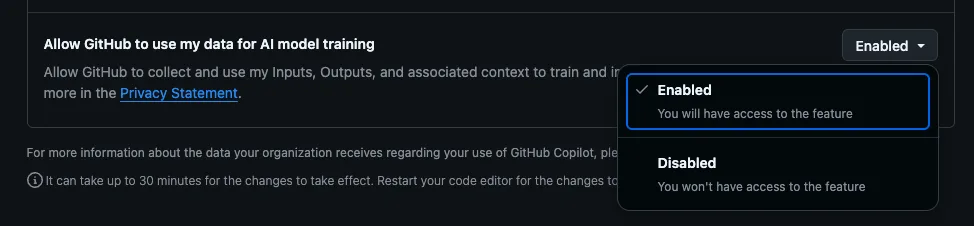

Mellé jön a rendszergazdai szintű budgetkontroll. Az adminisztrátorok mostantól vállalat, cost center és egyéni felhasználó szintjén is beállíthatnak kiadási küszöböt. Amikor a keret elfogy, eldönthetik, hogy a szervezet folytatja-e a használatot piaci áron, vagy kemény limitet állítanak be.

Amit én sok cégnél látok elkövetni: bevezetnek egy SaaS AI-eszközt, és aztán senki sem figyeli, hogy ki, mikor és mennyit használja. Usage-based modellnél ez a hozzáállás gyorsan fájni fog.

A jó hír az, hogy a GitHub erre is gondolt: május elején elindít egy előnézeti számlázási felületet, ahol a felhasználók és az adminok előre láthatják, milyen várható költséget generál a jelenlegi használatuk, még mielőtt az éles rendszer június 1-jén elindul.

Hogyan érint ez egy fejlesztőt vagy karrierváltót

Ha valaki még most ismerkedik a Copilottal, és a Copilot Free csomagot használja, a változás egyelőre kevéssé érinti. A Free csomag az eddigi korlátok mellett marad, és az AI Credits rendszer elsősorban a fizetős tervekben válik érzékelhetővé.

Ha viszont valaki rendszeresen, komolyan használja az eszközt – különösen az agentic funkciókat, ahol a Copilot önállóan fut végig feladatokon –, érdemes számolni azzal, hogy az ilyen munkamenetek token-fogyasztása lényegesen magasabb, mint egy egyszerű kódkiegészítésé. A GitHub maga is elismeri, hogy ma egy gyors kérdés és egy többórás autonóm kódolási session ugyanannyiba kerül az eddigi rendszerben. Ez tarthatatlan volt, és a változtatás logikus.

Amit érdemes megjegyezni

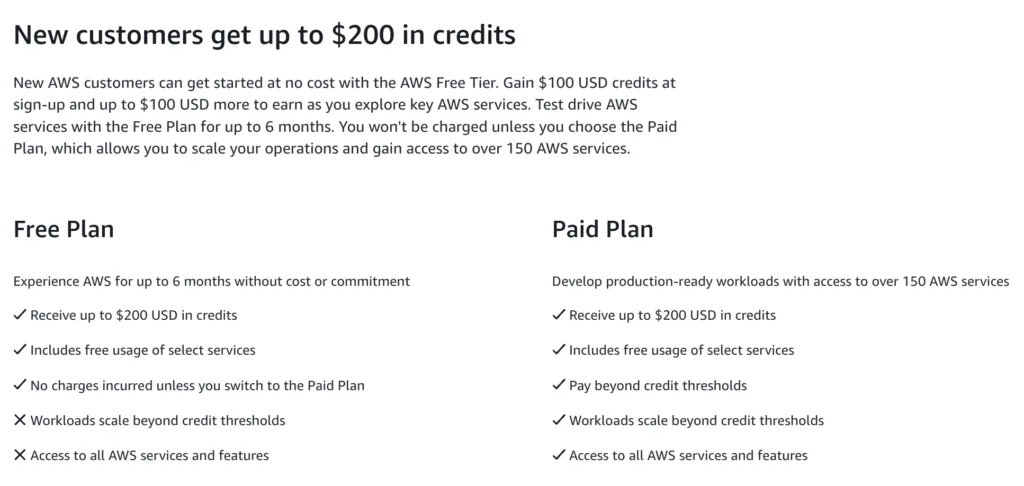

Ez a váltás nem egyedi fejlemény. Pontosan ezt a trendet látom az egész cloud és AI iparágban: a flat-rate, havi díjas modellek lassan átadják helyüket a fogyasztásalapú árazásnak. Az AWS már régóta ezen az elven működik, és a nagy AI-szolgáltatók többsége is token-alapú számlázást alkalmaz.

A GitHub Copilot esetében ez egy nehéz, de szükséges lépés. Az agentic AI komoly számítási kapacitást igényel, és az egyáras modell hosszú távon fenntarthatatlan. Aki ezt megérti, az nem fejlesztői extra kiadásként tekint majd a Copilot-számlára, hanem üzleti döntésként: mennyit ér a csapat ideje, és mennyit spórol az AI-asszisztencia.

A legfontosabb teendő most: május elején nézd meg az előnézeti számlázási felületet a GitHub fiókodban vagy a céges adminfelületen, és ott mérd fel a valós fogyasztást, mielőtt a rendszer élesbe megy.